單變數線性回歸 (Simple Linear Regression)

簡介

給定兩變數 $X$ 與 $Y$,例如 $X$ 表達為讀書時間,$Y$ 表達為考試分數,我們希望找到一個函數 $f$,

$$ Y = f (X) $$稱為確定性模型 (deterministic model),使得給定 $X$ 後能直接確定 $Y$。例如 $Y = f (X) = 10 + 15 X$,但決定性模型通常不足以解釋真實的問題,例如相同讀書時間,但分數卻不會總是相同。這存在一些無法控制的隨機現象 (random phenomenon),但卻同樣影響著 $Y$,因此增加一個隨機變量 (random variable) 來解釋模型

$$ Y = f (X) + \varepsilon $$在給定 $n$ 筆資料 $(X_1, Y_1), (X_2, Y_2), \cdots, (X_n, Y_n)$ 後,我們希望找到一個線性模型

$$ \hat Y_i = f (X_i) = \beta_0 + \beta_1 X_i $$稱 $f$ 是回歸函數 (regression function),$\ut \beta = (\beta_0, \beta_1)$ 是 回歸係數 (regression coefficient),$\beta_1$ 稱為斜率項 (slope),$\beta_0$ 稱為截距項 (intercept),$\hat Y$ 是擬合值 (fitted value),而每筆資料的真實情況是存在隨機性的,寫成

$$ Y_i = f (X_i) = \beta_0 + \beta_1 X_i + \varepsilon_i $$此時我們會假設

- $E (\varepsilon_i) = 0$

- $\sigma^2 (\varepsilon_i) = \sigma^2$

- $\sigma (\varepsilon_i, \varepsilon_j) = 0$

因而做出下列推論

- $E (Y_i) = \beta_0 + \beta_1 X_i$

- $\sigma^2 (Y_i) = \sigma^2 (\beta_0 + \beta_1 X_i + \varepsilon_i) = \sigma^2$

- $\sigma (Y_i, Y_j) = \sigma (\varepsilon_i, \varepsilon_j) = 0$

最小平方法 (Least Squares Estimate, LSE)

對每筆資料計算出原始值與擬合值的差距,稱為殘差 (residual)

$$ e_i = Y_i - \hat Y_i = Y_i - \beta_0 - \beta_1 X_i $$並定義出殘差平方合 (residual sum of squares, sum squared error, SSE),此數可以做為評估模型擬合好壞的標準

$$ SSE = \sum_{i = 1}^{n} e_i^2 = \sum_{i = 1}^{n} (Y_i - \beta_0 - \beta_1 X_i)^2 $$而最小平方法 (Least Squares Estimate, LSE) 所要找的目標是 $\ut b = (b_0, b_1)$ 能最小化 SSE,即

$$ (b_0, b_1) = \argmin_{(\beta_0, \beta_1) \in \bb R^2} \ SSE $$求出

$$ \begin{align*} b_1 & = \frac{\sum_{i = 1}^{n} (X_i - \ol X) (Y_i - \ol Y)}{\sum_{i = 1}^{n} (X_i - \ol X)^2} \\ b_0 & = \frac{1}{n} \sum_{i = 1}^{n} Y_i - b_1 \sum_{i = 1}^{n} X_i = \ol Y - b_1 \ol X \end{align*} $$其中 $\ol X$ 和 $\ol Y$ 定義為 $X$ 與 $Y$ 的平均

$$ \begin{align*} \ol X = \frac{1}{n} \sum_{i = 1}^{n} X_i \quad \ol Y = \frac{1}{n} \sum_{i = 1}^{n} Y_i \end{align*} $$恆等式

引入兩個恆等式,在接下來的證明與後續推導經常會用到

$$ \dps \sum_{i = 1}^{n} (X_i - \ol X)^2 = \sum_{i = 1}^{n} X_i (X_i - \ol X) $$與

$$ \sum_{i = 1}^{n} (X_i - \ol X) (Y_i - \ol Y) = \sum_{i = 1}^{n} (X_i - \ol X) Y_i = \sum_{i = 1}^{n} X_i (Y_i - \ol Y) $$LSE 證明

要最小化 SSE,對其求導設為 $0$,即

$$ \begin{align*} & 0 = \frac{\partial}{\partial \beta_0} SSE = - 2 \sum_{i = 1}^{n} (Y_i - \beta_0 - \beta_1 X_i) \\ & 0 = \frac{\partial}{\partial \beta_1} SSE = - 2 \sum_{i = 1}^{n} X_i (Y_i - \beta_0 - \beta_1 X_i) \\ \end{align*} $$解出

$$ \begin{align*} 0 & = \sum_{i = 1}^{n} (Y_i - \beta_0 - \beta_1 X_i) \\ 0 & = \sum_{i = 1}^{n} X_i (Y_i - \beta_0 - \beta_1 X_i) \\ \end{align*} $$設 $(b_0, b_1)$ 為滿足此方程的解,稱為 normal equations

$$ \begin{align*} \sum_{i = 1}^{n} Y_i & = b_0 n + b_1 \sum_{i = 1}^{n} X_i \\ \sum_{i = 1}^{n} X_i Y_i & = b_0 \sum_{i = 1}^{n} X_i + b_1 \sum_{i = 1}^{n} X_i^2 \end{align*} $$第一式解出

$$ \begin{align*} b_0 = \frac{1}{n} \left( \sum_{i = 1}^{n} Y_i - b_1 \sum_{i = 1}^{n} X_i \right) = \ol Y - b_1 \ol X \end{align*} $$將 $b_0$ 代入第二式

$$ \begin{align*} \sum_{i = 1}^{n} X_i Y_i & = b_0 \sum_{i = 1}^{n} X_i + b_1 \sum_{i = 1}^{n} X_i^2 \\ & = (\ol Y - b_1 \ol X ) \sum_{i = 1}^{n} X_i + b_1 \sum_{i = 1}^{n} X_i^2 \end{align*} $$解出

$$ \begin{align*} b_1 & = \frac{\sum_{i = 1}^{n} X_i Y_i - \sum_{i = 1}^{n} X_i \ol Y}{\sum_{i = 1}^{n} X_i^2 - \ol X \sum_{i = 1}^{n} X_i} \\ & = \frac{\sum_{i = 1}^{n} X_i (Y_i - \ol Y) }{\sum_{i = 1}^{n} X_i ( X_i - \ol X)} \\ & = \frac{\sum_{i = 1}^{n} (X_i - \ol X) (Y_i - \ol Y) }{\sum_{i = 1}^{n} (X_i - \ol X)^2} \end{align*} $$或者以線性代數方式以表達,這種方式在多變數回歸經常使用

$$ \begin{align*} \begin{pmatrix} \dps \sum_{i = 1}^{n} Y_i \\ \dps \sum_{i = 1}^{n} X_i Y_i \end{pmatrix} = \begin{pmatrix} n & \dps \sum_{i = 1}^{n} X_i \\ \dps \sum_{i = 1}^{n} X_i & \dps \sum_{i = 1}^{n} X_i^2 \end{pmatrix} \begin{pmatrix} \beta_0 \\ \beta_1 \end{pmatrix} \end{align*} $$一樣能解出

$$ \begin{align*} \begin{pmatrix} \beta_0 \\ \beta_1 \end{pmatrix} & = \begin{pmatrix} n & \dps \sum_{i = 1}^{n} X_i \\ \dps \sum_{i = 1}^{n} X_i & \dps \sum_{i = 1}^{n} X_i^2 \end{pmatrix}^{-1} \begin{pmatrix} \dps \sum_{i = 1}^{n} Y_i \\ \dps \sum_{i = 1}^{n} X_i Y_i \end{pmatrix} \end{align*} $$表達式

根據前述的恆等式,$b_1$ 能有數種表達式

$$ \begin{align*} b_1 & = \frac{\sum_{i = 1}^{n} (X_i - \ol X) (Y_i - \ol Y)}{\sum_{i = 1}^{n} (X_i - \ol X)^2} \\ & = \frac{\sum_{i = 1}^{n} (X_i - \ol X) Y_i}{\sum_{i = 1}^{n} (X_i - \ol X)^2} \\ & = \frac{\sum_{i = 1}^{n} X_i (Y_i - \ol Y)}{\sum_{i = 1}^{n} (X_i - \ol X)^2} \end{align*} $$不偏性 (Unbiased)

LSE 估計的 $b_0$ 與 $b_1$ 都是不偏的 (unbiased),即 $E (b_0) = \beta_0$ 和 $E (b_1) = \beta_1$。特別注意,$E (Y_i) = \beta_0 + \beta_1 X_i$,因此

$$ \begin{align*} E (b_1) & = E \left( \frac{\sum_{i = 1}^{n} (X_i - \ol X) Y_i}{\sum_{i = 1}^{n} (X_i - \ol X)^2} \right) \\ & = \frac{\sum_{i = 1}^{n} (X_i - \ol X) (\beta_0 + \beta_1 X_i)}{\sum_{i = 1}^{n} (X_i - \ol X)^2} \\ & = \beta_0 \left( \frac{\sum_{i = 1}^{n} (X_i - \ol X) }{\sum_{i = 1}^{n} (X_i - \ol X)^2} \right) + \beta_1 \left( \frac{\sum_{i = 1}^{n} (X_i - \ol X) X_i }{\sum_{i = 1}^{n} (X_i - \ol X)^2} \right) \\ & = \beta_0 \cdot 0 + \beta_1 \cdot 1 \\ & = \beta_1 \end{align*} $$而

$$ \begin{align*} E (\ol Y) & = E \left( \frac{1}{n} \sum_{i = 1}^{n} Y_i \right) \\ & = \frac{1}{n} \sum_{i = 1}^{n} (\beta_0 + \beta_1 X_i) \\ & = \beta_0 + \beta_1 \ol X \end{align*} $$因此

$$ \begin{align*} E (b_0) & = E (\ol Y - b_1 \ol X) \\ & = (\beta_0 + \beta_1 \ol X) - \beta_1 \ol X \\ & = \beta_0 \end{align*} $$回歸線性質

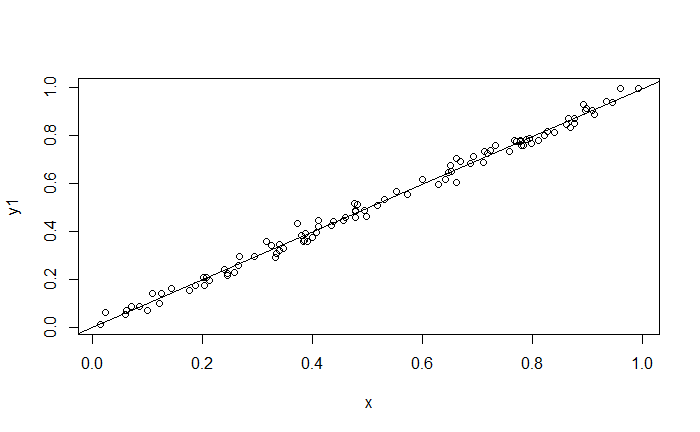

用給定的 $n$ 筆資料與 LSE 計算出 $b_0$ 與 $b_1$,估計出以下回歸線 (regression line)

$$ \begin{align*} \hat Y = f (X) = \beta_0 + \beta_1 X \end{align*} $$並稱 $\hat Y_i$ 為第 $i$ 筆資料的擬合值 (fitted value)

$$ \begin{align*} \hat Y_i = f (X_i) = \beta_0 + \beta_1 X_i \end{align*} $$對此回歸線我們有以下性質

- 原始 $Y$ 的和等於擬合 $\hat Y$ 的和

- 回歸線通過資料中心 $(\ol X, \ol Y)$,即

- 殘差和為$0$

變異數 $\sigma^2$ 估計

直接上結論,證明在後續的章節補

$$ \begin{align*} E (SSE) = E \left( \sum_{i = 1}^{n} e_i^2 \right) = (n - 2) \sigma^2 \end{align*} $$定義均方誤差 (mean square error, MSE) 為

$$ \begin{align*} MSE = \frac{SSE}{n - 2} \end{align*} $$可得出 $MSE$ 是 $\sigma^2$ 的不偏估計量

$$ \begin{align*} E (MSE) = E \left( \frac{SSE}{n - 2} \right) = \sigma^2 \end{align*} $$因此後續都會用 $MSE$ 估計 $\sigma^2$,用 $\sqrt{MSE}$ 估計 $\sigma$。

常態假設 (Normal Assumption)

現假設隨機現象 $\varepsilon_i$ 的分布服從常態分佈 (normal distribution),即

$$ Y_i = \beta_0 + \beta_1 X_i + \varepsilon_i $$且 $\varepsilon_i \iid N (0, \sigma^2)$,滿足一開始的三項條件

- $E (\varepsilon_i) = 0$

- $\sigma^2 (\varepsilon_i) = \sigma^2$

- $\sigma (\varepsilon_i, \varepsilon_j) = 0$

因此前面的所有的推論在後續內容仍然適用,也自然的能推論到

$$ \begin{align*} Y_i \sim N (\beta_0 + \beta_1 X_i, \sigma^2) \end{align*} $$且滿足

- $E (Y_i) = \beta_0 + \beta_1 X_i$

- $\sigma^2 (Y_i) = \sigma^2$

- $\sigma (Y_i, Y_j) = 0$

參數最大概似估計 (Maximum Likelihood Estimation, MLE)

在單筆資料下給定 $X_i$ 下,$Y_i$ 的機率密度函數 (probability density function, pdf) 為

$$ \begin{align*} f (Y_i) = \frac{1}{\sqrt{2 \pi} \sigma} \exp \left[ - \frac{1}{2} \left( \frac{Y_i - \beta_0 - \beta_1 X_i}{\sigma} \right)^2 \right] \end{align*} $$在所有資料下所對應的概似函數 (likelihood function) 為

$$ \begin{align*} L (\beta_0, \beta_1, \sigma^2) & = \prod_{i = 1}^{n} \frac{1}{\sqrt{2 \pi} \sigma} \exp \left[ - \frac{1}{2} \left( \frac{Y_i - \beta_0 - \beta_1 X_i}{\sigma} \right)^2 \right] \\ & = (2 \pi \sigma^2)^{- n / 2} \exp \left[ - \frac{1}{2 \sigma^2} \sum_{i = 1}^{n} (Y_i - \beta_0 - \beta_1 X_i)^2 \right] \end{align*} $$取對數後找到 log-likelihood function

$$ \begin{align*} l (\beta_0, \beta_1, \sigma^2) & = \ln L (\beta_0, \beta_1, \sigma^2) \\ & = - \frac{n}{2} \ln (2 \pi) - \frac{n}{2} \ln (\sigma^2) - \frac{1}{2 \sigma^2} \sum_{i = 1}^{n} (Y_i - \beta_0 - \beta_1 X_i)^2 \end{align*} $$要將 $l$ 最大化,對其求導設為 $0$,即

$$ \begin{align*} 0 & = \frac{\partial}{\partial \beta_0} l = \frac{1}{\sigma^2} \sum_{i = 1}^{n} (Y_i - \beta_0 - \beta_1 X_i) \\ 0 & = \frac{\partial}{\partial \beta_1} l = \frac{1}{\sigma^2} \sum_{i = 1}^{n} X_i (Y_i - \beta_0 - \beta_1 X_i) \\ 0 & = \frac{\partial}{\partial \sigma^2} l = - \frac{n}{2 \sigma^2} + \frac{1}{\sigma^4} \sum_{i = 1}^{n} (Y_i - \beta_0 - \beta_1 X_i) \\ \end{align*} $$設 $(\hat \beta_0, \hat \beta_1, \hat \sigma^2)$ 為解,其滿足

$$ \begin{align*} 0 & = \sum_{i = 1}^{n} (Y_i - \hat \beta_0 - \hat \beta_1 X_i) \\ 0 & = \sum_{i = 1}^{n} X_i (Y_i - \hat \beta_0 - \hat \beta_1 X_i) \\ \hat \sigma^2 & = \frac{\sum_{i = 1}^{n} (Y_i - \hat \beta_0 - \hat \beta_1 X_i)}{n} = \frac{SSE}{n} \end{align*} $$會發現 MLE 的 $(\hat \beta_0, \hat \beta_1)$ 所滿足的條件與 LSE 的 $(b_0, b_1)$ 相同,因此他們是相同的解;而 MLE 的 $\hat \sigma^2$ 可以寫成

$$ \begin{align*} \hat \sigma^2 = \frac{n - 2}{n} MSE \end{align*} $$MLE 對變異數的估計量帶有些微偏差 (biased),在 $n \to \infty$ 的條件下 $\hat \sigma^2$ 是漸進逼近不偏

$$ \begin{align*} E (\hat \sigma^2) = \frac{n - 2}{n} \sigma^2 \end{align*} $$但因為 LSE 所計算的 $\sigma^2$ 是不偏的,一般仍會使用 LSE 作為 $\sigma^2$ 的估計量。

斜率項 $\beta_1$ 推論

在沒有常態假設前,我們就已經證明 LSE 的估計量 $b_1$ 是不偏的 $E (b_1) = \beta_1$。而 $\beta_1$ 所代表的意義是

每增加一單位的 $X$,$Y$ 就會相對應的增加 $\beta_1$

寫成

$$ \begin{align*} f (X + 1) - f (X) = [\beta_0 + \beta_1 (X + 1)] - [\beta_0 + \beta_1 X] = \beta_1 \end{align*} $$$b_1$ 分布

根據常態假設 $Y_i \sim N (0, \sigma^2)$,得出

$$ \begin{align*} b_1 & = \frac{\sum_{i = 1}^{n} (X_i - \ol X) Y_i}{\sum_{i = 1}^{n} (X_i - \ol X)^2 } \\ & \sim N \left( \beta_1, \frac{\sum_{i = 1}^{n} (X_i - \ol X)^2 \sigma^2 }{[\sum_{i = 1}^{n} (X_i - \ol X)^2]^2 } \right) \\ & \sim N \left( \beta_1, \frac{\sigma^2 }{\sum_{i = 1}^{n} (X_i - \ol X)^2 } \right) \end{align*} $$但 $\sigma^2$ 是未知的,我們會用 $MSE$ 來估計 $\sigma^2$,得出樣本變異數 (sample variance) 的版本

$$ \begin{align*} s^2 (b_1) = \frac{MSE}{\sum_{i = 1}^{n} (X_i - \ol X)^2} \end{align*} $$$(b_1 - \beta_1) / s (b_1)$ 分布

在常態假設下

$$ \begin{align*} \frac{SSE}{\sigma^2} \sim \chi_{n - 2}^2 \end{align*} $$且與 $b_0$ 與 $b_1$ 獨立。考慮其標準化後的結果

$$ \begin{align*} \frac{b_1 - \beta_1}{s (b_1)} & = \frac{b_1 - \beta_1}{\sigma (b_1)} / \sqrt{ \frac{s^2 (b_1)}{\sigma^2 (b_1)} } \end{align*} $$其中 $(b_1 - \beta_1) / \sigma (b_1) \sim Z$ ($Z$ 在後續均表示為標準常態分布),另一部分

$$ \begin{align*} \frac{s^2 (b_1)}{\sigma^2 (b_1)} = \frac{MSE}{\sigma^2} = \frac{SSE}{\sigma^2 (n - 2)} \sim \frac{\chi_{n - 2}^2}{n - 2} \end{align*} $$故

$$ \begin{align*} \frac{b_1 - \beta_1}{s (b_1)} \sim Z / \sqrt{ \frac{\chi_{n - 2}^2}{n - 2} } \sim t_{n - 2} \end{align*} $$$\beta_1$ 信賴區間

給定 $q \in (0, 1)$,定義 $t_{n - 2} (q)$ 為

$$ \begin{align*} P (t_{n - 2} \leq t_{n - 2} (1 - q)) = q \end{align*} $$且因為 $t$ 分布是對稱的,得出

$$ \begin{align*} t_{n - 2} (q) = - t_{n - 2} (1 - q) \end{align*} $$在給定顯著水準 $\alpha \in (0, 1)$ 下,得出

$$ \begin{align*} 1 - \alpha & = P \left( t_{n - 2} (\alpha / 2) \leq t_{n - 2} \leq t_{n - 2} (1 - \alpha / 2) \right) \\ & = P \left( t_{n - 2} \in \left( \pm t_{n - 2} (1 - \alpha / 2) \right) \right) \\ & = P \left( \frac{b_1 - \beta_1}{s (b_1)} \in \left( \pm t_{n - 2} (1 - \alpha / 2) \right) \right) \\ & = P \left( \beta_1 \in b_1 \pm s (b_1) t_{n - 2} (1 - \alpha / 2) \right) \end{align*} $$故 $1 - \alpha$ 的 $\beta_1$ 信賴區間為

$$ \begin{align*} b_1 \pm s (b_1) t_{n - 2} (1 - \alpha / 2) \end{align*} $$$\beta_1$ 假設檢定

雙邊檢定

給定任一常數 $\beta_{10}$,若要假設檢定

$$ H : \beta_1 = \beta_{10} \quad \text{vs} \quad A : \beta_1 \ne \beta_{10} $$其檢定量為

$$ t^* = \frac{b_1 - \beta_{10}}{s (b_1)} $$在 $\alpha$ 的信心水準下

- 若 $|t^*| \leq t_{n - 2} (1 - \alpha / 2)$ 推論 $H$

- 若 $|t^*| > t_{n - 2} (1 - \alpha / 2)$ 推論 $A$

單邊檢定

給定任一常數 $\beta_{10}$,若要假設檢定

$$ H : \beta_1 \leq \beta_{10} \quad \text{vs} \quad A : \beta_1 > \beta_{10} $$其檢定量為

$$ t^* = \frac{b_1 - \beta_{10}}{s (b_1)} $$在 $\alpha$ 的信心水準下

- 若 $|t^*| \leq t_{n - 2} (1 - \alpha)$ 推論 $H$

- 若 $|t^*| > t_{n - 2} (1 - \alpha)$ 推論 $A$

截距項 $\beta_0$ 推論

LSE 的估計量 $b_1$ 可以寫成

$$ b_0 = \ol Y - b_1 \ol X $$其中得 $\ol Y \sim N (0, \sigma^2 / n)$,另一部分

$$ b_1 \ol X \sim \ol X \cdot N \left( 0, \frac{\sigma^2}{\sum_{i = 1}^{n} (X_i - \ol X)^2} \right) \\ \sim N \left( 0, \frac{\sigma^2 \ol X^2}{\sum_{i = 1}^{n} (X_i - \ol X)^2} \right) $$因此

$$ b_0 \sim N \left( 0, \sigma^2 \left[ \frac{1}{n} + \frac{\ol X^2}{\sum_{i = 1}^{n} (X_i - \ol X)^2} \right] \right) $$用 MSE 取代未知的 $\sigma^2$,得出

$$ s^2 (b_0) = MSE \left( \frac{1}{n} + \frac{\ol X^2}{\sum_{i = 1}^{n} (X_i - \ol X)^2} \right) $$考慮標準化後的統計量

$$ \frac{b_0 - \beta_0}{s (b_0)} \sim t_{n - 2} $$其信賴區間建構與假設檢定方式與 $b_1$ 基本相同,不再贅述。

區間估計

給定 $X_h$,我們對 $Y_h$ 的點估計都是用

$$ \hat Y_h = f (X_h) = b_0 + b_1 X_h $$而對區間估計,我們會考慮兩種區間:

- 信賴區間 (confidence interval):用於參數的估計,或舊有資料的估計。考慮已有資料的隨機性 $(\contia{\varepsilon}{n})$,其考慮的對象是

- 預測區間 (prediction interval):用於新資料的估計。不僅考慮已有資料的隨機性 $(\contia{\varepsilon}{n})$,還有額外考慮新資料的隨機性,其考慮的對象是

信賴區間 (Confidence Interval)

任取一個資料點 $X_h$,其預測值 $\hat Y_h$ 的分布是

$$ \begin{align*} \hat Y_h & = b_0 + b_1 X_h \\ & \sim N \left( \beta_0 + \beta_1 X_h, \sigma^2 \left[ \frac{1}{n} + \frac{(X_h - \ol X)^2}{\sum_{i = 1}^{n} (X_i - \ol X)^2} \right] \right) \\ & \sim N \left( E (Y_h), \sigma^2 \left[ \frac{1}{n} + \frac{(X_h - \ol X)^2}{\sum_{i = 1}^{n} (X_i - \ol X)^2} \right] \right) \end{align*} $$其中

$$ \begin{align*} \sigma^2 (\hat Y_h) = \sigma^2 \left[ \frac{1}{n} + \frac{(X_h - \ol X)^2}{\sum_{i = 1}^{n} (X_i - \ol X)^2} \right] \end{align*} $$用 $MSE$ 估計未知的 $\sigma^2$,得出

$$ \begin{align*} s^2 (\hat Y_h) = MSE \left[ \frac{1}{n} + \frac{(X_h - \ol X)^2}{\sum_{i = 1}^{n} (X_i - \ol X)^2} \right] \end{align*} $$證明 $\sigma^2 (\hat Y_h)$

雖然有 $b_0$ 與 $b_1$ 各自的分布,但需要考慮 $\sigma (b_0, b_1)$,其共變異數一般非 $0$,所以用另一種方式

$$ \begin{align*} \hat Y_h = \ol Y + b_1 (X_h - \ol X) \end{align*} $$其變異數為

$$ \begin{align*} \sigma^2 (\hat Y_h) & = \sigma^2 (\ol Y) + \sigma^2 (b_1 (X_h - \ol X)) + 2 \sigma (\ol Y, b_1 (X_h - \ol X)) \\ & = \frac{\sigma^2}{n} + \frac{\sigma^2 (X_h - \ol X)^2}{\sum_{i = 1}^{n} (X_i - \ol X)^2} + 2 (X_h - \ol X)^2 \sigma (\ol Y, b_1) \end{align*} $$特別注意 $\sigma (Y_i, Y_i) = \sigma^2 (Y_i) = \sigma^2$ 和 $\sigma (Y_i, Y_j) = 0$ 對 $i \ne j$,因此其中的

$$ \begin{align*} \sigma (\ol Y, b_1) & = \sigma \left( \frac{1}{n} \sum_{i = 1}^{n} Y_i, \frac{\sum_{i = 1}^{n} (X_i - \ol X) Y_i}{\sum_{j = 1}^{n} (X_j - \ol X)^2} \right) \\ & = \frac{\sigma^2}{n} \frac{\sum_{i = 1}^{n} (X_i - \ol X)}{\sum_{j = 1}^{n} (X_j - \ol X)^2} \\ & = 0 \end{align*} $$因此

$$ \begin{align*} \sigma^2 (\hat Y_h) = \sigma^2 \left[ \frac{1}{n} + \frac{(X_h - \ol X)^2}{\sum_{i = 1}^{n} (X_i - \ol X)^2} \right] \end{align*} $$而標準化後的分布呈現

$$ \begin{align*} \frac{\hat Y_h - E (Y_h)}{s (\hat Y_h)} \sim t_{n - 2} \end{align*} $$用此建構對 $E (Y_h) = \beta_0 + \beta_1 X_h$ 的 $1 - \alpha$ 的信賴區間

$$ \begin{align*} \hat Y_h \pm s (\hat Y_h) t_{n - 2} (1 - \alpha / 2) \end{align*} $$預測區間 (Prediction Interval)

給定一筆新資料 $X_{h (new)}$,預測新的

$$ \begin{align*} \hat Y_{h (new)} = b_0 + b_1 X_{h (new)} \end{align*} $$假設真實的

$$ \begin{align*} Y_{h (new)} = \beta_0 + \beta_1 X_{h (new)} + \varepsilon_{h (new)} \end{align*} $$其中 $\varepsilon_{h (new)}$ 仍然滿足常態假設

- $E (\varepsilon_{h (new)}) = 0$

- $\sigma^2 (\varepsilon_{h (new)}) = \sigma$

- $\sigma (\varepsilon_{h (new)}, \varepsilon_i) = 0$ 對任意 $i = \conti{n}$

因此 $Y_{h (new)}$ 獨立於原有的資料點 $(\contia{Y}{n})$,需要額外考慮新資料的隨機性 $\varepsilon_{h (new)}$,定義

$$ \begin{align*} \sigma^2 (pred) & = \sigma^2 (\hat Y_{h (new)} - Y_{h (new)}) \\ & = \sigma^2 (\hat Y_{h (new)}) + \sigma^2 (Y_{h (new)}) \\ & = \sigma^2 (\hat Y_{h (new)}) + \sigma^2 \end{align*} $$用 $MSE$ 估計未知的 $\sigma^2$,得出

$$ \begin{align*} s^2 (pred) & = s^2 (\hat Y_{h (new)}) + MSE \\ & = MSE \left( 1 + \frac{1}{n} + \frac{(X_h - \ol X)^2}{\sum_{i = 1}^{n} (X_i - \ol X)^2} \right) \end{align*} $$而標準化後的分布呈現

$$ \begin{align*} \frac{\hat Y_{h (new)} - Y_{h (new)}}{s (pred)} \sim t_{n - 2} \end{align*} $$用此建構出 $\hat Y_{h (new)}$ 的預測區間

$$ \begin{align*} \hat Y_{h (new)} \pm s (pred) t_{n - 2} (1 - \alpha / 2) \end{align*} $$信賴區間與預測區間

無論是信賴區間或預測區間,都能在變異數的分子部份看到 $(X_h - \ol X)^2$,體現為"資料點 $X_h$ 越遠離中心點 $\ol X$,變異數就越大";換句話說

要預測的資料 $X_h$ 越遠離中心點 $\ol X$,預測效力越低

這個現象不僅出現在線性回歸,這是所有預測模型的基本限制

預測只做內差 (interpolation) 不做外差 (extrapolation)。例如原始資料中 $X$ 取值範圍僅在 $(0, 1)$,預測新資料 $X_h = 10$ 顯然不是明智之舉。

區間大小

預測區間的中心點全都落在 $b_0 + b_1 X$。而信賴區間 (用 $s^2 (\hat Y_h)$) 與預測區間 (用 $s^2 (pred)$) 的樣本變異數在"是否考慮新資料的隨機性",差 $1$ 個 $MSE$ 即是出自於新資料的隨機性

$$ \begin{align*} s^2 (\hat Y_h) & = MSE \left( \frac{1}{n} + \frac{(X_h - \ol X)^2}{\sum_{i = 1}^{n} (X_i - \ol X)^2} \right) \\ s^2 (pred) & = MSE \left( 1 + \frac{1}{n} + \frac{(X_h - \ol X)^2}{\sum_{i = 1}^{n} (X_i - \ol X)^2} \right) \end{align*} $$在給定信心準水下,信賴區間會在預測區間中心,且信賴區間比預測區間小。

參考資料

Applied linear statistical models. NETER, John, et al. 1996.